MonitorUpdate.com – Suara itu terdengar begitu akrab—intonasinya pas, panggilannya khas, bahkan nada paniknya terasa nyata.

“Mah, aku butuh uang sekarang. Tolong transfer.”

Tak ada alasan untuk curiga. Dalam hitungan menit, uang berpindah.

Belakangan baru disadari: suara itu bukan milik anaknya.

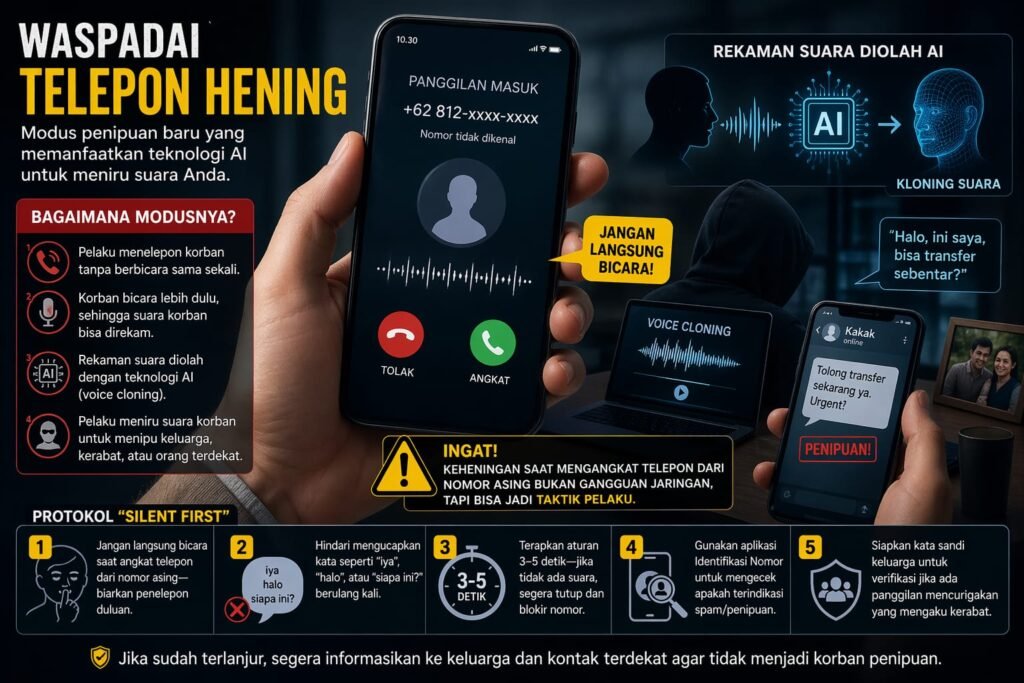

Kasus seperti ini mulai bermunculan—tanpa label yang jelas, tanpa kesadaran publik yang memadai. Di baliknya, ada teknologi yang berkembang jauh lebih cepat dari kewaspadaan masyarakat: voice cloning.

Baca Juga : “Telepon Hening” dan Ketakutan Baru AI: Modus Nyata atau Sekadar Pesan Berantai?

Lonjakan Penipuan, Teknologi Baru di Baliknya

Data Otoritas Jasa Keuangan (OJK) menunjukkan, laporan penipuan keuangan digital di Indonesia terus meningkat dalam beberapa tahun terakhir. Modusnya beragam—mulai dari phishing, social engineering, hingga vishing (voice phishing).

Namun, pakar keamanan siber mulai melihat pola baru.

“Sekarang bukan hanya menipu lewat kata-kata, tapi lewat suara yang ‘dipinjam’ dari korban sendiri atau orang terdekatnya,” kata pengamat keamanan siber dari Universitas Indonesia, Pratama Persadha.

Menurut dia, voice cloning mengubah lanskap penipuan menjadi lebih presisi dan personal.

Indonesia: Target Empuk Social Engineering

Indonesia bukan sekadar pasar besar secara digital. Ia juga rentan secara sosial.

Data Kementerian Komunikasi dan Informatika mencatat:

• lebih dari 200 juta pengguna internet

• penetrasi media sosial yang tinggi

• kebiasaan berbagi konten audio-visual tanpa pembatasan

“Ini ladang data bagi pelaku. Banyak orang tanpa sadar mengunggah suara mereka—dan itu bisa dikloning,” ujar Pratama.

Dalam konteks ini, voice cloning bukan berdiri sendiri, melainkan bagian dari teknik lama: social engineering—memanipulasi manusia, bukan sistem.

Cukup 10 Detik untuk Menipu

Perkembangan AI membuat voice cloning semakin mudah diakses.

Menurut peneliti di Badan Riset dan Inovasi Nasional (BRIN), model terbaru bahkan bisa bekerja dengan sampel suara sangat singkat.

“Dengan 10–30 detik rekaman, sistem sudah bisa membangun profil suara yang cukup akurat untuk menipu orang awam,” kata seorang peneliti AI BRIN.

Ini berarti:

• video TikTok

• voice note WhatsApp

• rekaman wawancara

semuanya bisa menjadi “bahan mentah” kejahatan.

Krisis Bukti: Audio Tak Lagi Sakral

Dampak paling serius dari voice cloning mungkin bukan pada penipuan individu, tetapi pada runtuhnya kepercayaan terhadap bukti audio.

Dalam praktik jurnalistik, rekaman suara selama ini dianggap relatif valid. Namun kini, asumsi itu goyah.

“Ke depan, jurnalis tidak bisa lagi hanya mengandalkan rekaman suara. Harus ada verifikasi berlapis,” kata dosen komunikasi digital dari Universitas Gadjah Mada.

Ancaman ini meluas ke ranah politik:

• rekaman palsu pejabat

• pernyataan fiktif tokoh publik

• propaganda berbasis audio

• Dengan kata lain, voice cloning membuka pintu disinformasi generasi baru.

• Hukum Tertinggal, Pelaku Melaju

• Hingga kini, Indonesia belum memiliki regulasi spesifik terkait voice cloning.

Penegakan hukum masih mengandalkan:

• Undang-Undang ITE

• pasal penipuan dalam KUHP

Namun keduanya belum dirancang untuk menghadapi manipulasi berbasis AI.

“Masalahnya bukan hanya penindakan, tapi pembuktian. Bagaimana memastikan sebuah suara itu asli atau palsu di pengadilan?” kata praktisi hukum siber.

Lebih rumit lagi, pelaku sering berada di luar negeri, menggunakan infrastruktur digital yang sulit dijangkau yurisdiksi Indonesia.

Siapa yang Paling Rentan?

Voice cloning tidak menyerang semua orang secara merata. Ada kelompok yang lebih rentan:

• Orang tua → mengandalkan suara sebagai identitas

• Pelaku UMKM & bisnis → rawan instruksi transfer palsu

• Pejabat & tokoh publik → target manipulasi opini

• Jurnalis → berisiko terjebak pada sumber audio palsu

Dalam beberapa simulasi keamanan siber, tingkat keberhasilan penipuan meningkat drastis ketika suara digunakan dibanding teks.

Dari Kepercayaan ke Kecurigaan

Selama puluhan tahun, suara adalah simbol keaslian. Hari ini, ia justru menjadi celah manipulasi.

“Ini bukan sekadar soal teknologi, tapi soal kepercayaan sosial,” kata Pratama.

Jika masyarakat mulai meragukan suara yang mereka dengar, maka:

• komunikasi menjadi tidak pasti

• informasi menjadi ambigu

• kepercayaan publik terkikis

Era Baru Ketidakpastian

Voice cloning menandai fase baru dalam kejahatan digital—lebih halus, lebih personal, dan lebih sulit dideteksi.

Indonesia, dengan ekosistem digital yang tumbuh cepat namun literasi yang belum merata, berada dalam posisi rentan.

Pertanyaannya kini bukan lagi apakah teknologi ini akan digunakan, tetapi: Seberapa banyak korban yang harus jatuh sebelum negara benar-benar siap? (MU01)